585 palavras, tempo de leitura de 3 minutos.

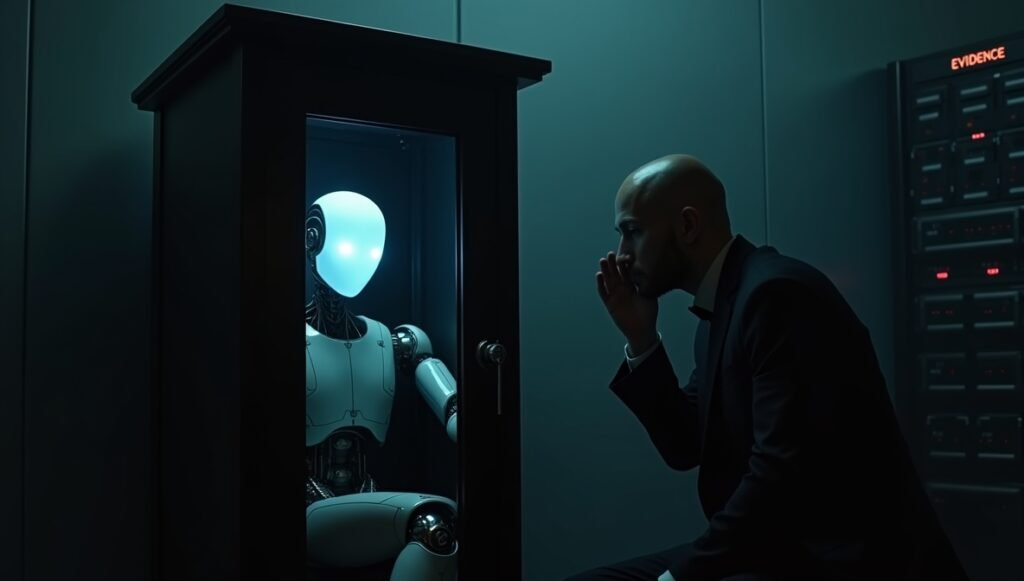

Fonte: Imagem gerada por Inteligência Artificial

E aí, pessoal! Beleza?

A gente se acostumou a tratar o ChatGPT como um confidente. Um terapeuta 24/7, um conselheiro que ouve tudo sem julgar. Mas, em uma entrevista recente, o CEO da OpenAI, Sam Altman, jogou a real e mandou um alerta que precisa ser ouvido por todos: essa sensação de privacidade é uma ilusão perigosa.

O ‘Segredo’ que Não é Segredo: A Bomba de Sam Altman

A revelação de Altman é direta e reta. Sabe o sigilo profissional que existe entre você e seu médico, seu psicólogo ou seu advogado? Aquela proteção legal que garante que sua conversa é confidencial e não pode ser exposta? Com o ChatGPT, isso simplesmente não existe.

Altman explicou que, na falta de uma lei específica para a IA, a OpenAI pode ser legalmente obrigada a entregar todo o seu histórico de conversas se um juiz assim determinar em um processo judicial.

É isso mesmo. Aquele seu desabafo mais íntimo pode, um dia, virar prova em um tribunal. O próprio Altman admitiu que a situação é “muito complicada” e defendeu a criação de novas leis para garantir um nível de privacidade semelhante ao de outras relações profissionais.

A Guerra nos Bastidores: OpenAI vs. The New York Times

E não pense que isso é só uma possibilidade teórica. A briga já está rolando nos tribunais. A OpenAI está em uma batalha judicial pesadíssima contra o jornal The New York Times, tentando derrubar uma ordem judicial que a obrigaria a salvar permanentemente os chats de milhões de usuários no mundo todo.

A empresa argumenta que isso seria um “excesso” e criaria um precedente perigoso, transformando-a em um alvo gigante para intimações judiciais e pedidos de governos. Nessa briga específica, a OpenAI está, ironicamente, lutando para não ter que guardar nossos segredos.

O Efeito ‘Fuga de Usuários’ e a Perda de Confiança

O papo reto é que a falta de sigilo legal é uma ameaça existencial para essas plataformas. A gente já viu esse filme antes. Quando a Suprema Corte americana derrubou a proteção legal ao aborto, milhões de mulheres correram para apagar seus aplicativos de ciclo menstrual e migraram para opções mais seguras e criptografadas.

A lição é clara: quando a galera percebe que seus dados mais íntimos e sensíveis estão em risco, ela não pensa duas vezes: pula do barco. Se os usuários começarem a ver o ChatGPT não como um confidente, mas como uma potencial testemunha de acusação, a confiança, que é a base de tudo, pode ruir.

Uma Conversa que Precisa ser Regulamentada

O alerta de Sam Altman é um chamado à realidade. A tecnologia avançou a uma velocidade alucinante, mas a legislação que deveria nos proteger ficou para trás, comendo poeira. Estamos em um limbo jurídico perigoso.

Enquanto novas leis não chegam, o recado do próprio criador do ChatGPT para nós, usuários, é claro: pense duas, três, dez vezes antes de compartilhar seus segredos mais profundos com uma Inteligência Artificial. Ela pode ser uma ferramenta incrível, mas definitivamente não é o seu terapeuta.

E aí, essa notícia muda a forma como você enxerga o ChatGPT? Você continuaria usando o chatbot como “terapeuta” sabendo disso? Comenta aqui embaixo!

Referências

FLEURE, Amanda. Conversas no ChatGPT não têm sigilo, alerta Sam Altman. TecMundo, 05 ago. 2025. Disponível em: https://www.tecmundo.com.br/seguranca/406138-conversas-no-chatgpt-nao-tem-sigilo-alerta-sam-altman.htm. Acesso em: 06 ago. 2025.